- 联系我们

- duidaima.com 版权声明

- 闽ICP备2020021581号

-

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

堆代码讯 在大语言模型(LLM)的技术浪潮中,苹果的研发脚步从未停歇。从 Xcode 26.3 引入代理式编码工具,为开发者带来 AI 辅助的开发体验开始,苹果在 “直观编码” 与 AI 应用落地的探索,正在向更深的领域延伸。近期,苹果通过机器学习博客,公布了两项全新的 AI 研究成果:一项是能让开发者灵活定制的 AI 驱动 UI 原型设计系统 SQUIRE,另一项则是用于增强图像安全评级的 SafetyPairs 框架,这两项研究未来都有望融入 iOS、macOS 与 Xcode 等苹果生态产品中,为开发者与用户带来全新的体验。

此前,随着 Xcode 26.3 的发布,苹果已经率先迈出了 AI 辅助开发的一步:该版本正式引入了对代理式编码工具的支持,让开发者可以在 AI 的辅助下完成项目的规划、执行与迭代。更重要的是,Xcode 原生兼容了 Anthropic Claude Agent、OpenAI Codex 等主流大语言模型工具,让开发者无需额外配置,就能直接借助主流 AI 能力提升开发效率。而这,仅仅是苹果在 AI 赋能开发领域的起点。

在 UI 开发领域,AI 生成工具早已不是新鲜事,但长期以来,这类工具都存在着难以忽视的痛点:很多 LLM 驱动的 UI 生成工具,只能根据用户的提示词一次性输出完整的设计成品,几乎没有给开发者留下微调的空间;而少数支持调整的工具,也常常无法按照开发者的预期执行修改,最终导致开发者不得不陷入反复试错的循环,反而拖慢了开发进度。

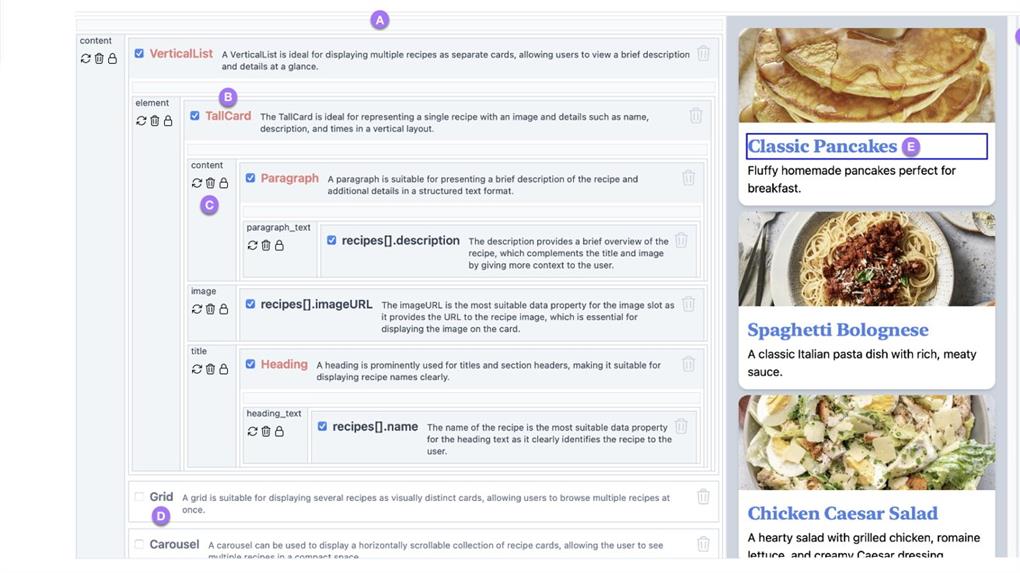

为了解决这个问题,苹果的研究团队推出了全新的 SQUIRE 系统,在一篇名为《SQUIRE:通过槽位查询中间表示实现交互式 UI 创作》的论文中,研究人员将其定义为 “用于引导式原型探索与优化的系统”。

这套系统由 OpenAI 的 GPT-4o 驱动,它最大的创新,就是在交付最终的 UI 原型之前,先为开发者提供一个可定制的组件树。不同于传统工具直接输出成品代码,SQUIRE 会先把 UI 拆解成一个个可编辑的独立元素,开发者可以直接查看、修改这些构成界面的基础模块:调整 UI 元素的字体、为元素添加承载新信息的附加图层,甚至直接替换整个元素,都可以在这个阶段完成。

当开发者调整到满意的状态后,SQUIRE 会自动把这个定制好的组件树,转换成可直接运行的代码,包括 HTML、CSS 等网页开发所需的文件,快速生成可用的界面原型。为了验证这套系统的实用性,研究团队邀请了 11 位前端开发人员,使用 SQUIRE 为移动设备创建网页原型。结果显示,参与测试的开发者都对 SQUIRE 给出了正面的评价,无论是工具的可用性,还是整体的使用满意度,都获得了认可。

正如论文中总结的:“将聊天与明确限定范围的交互能力相结合,在快速 UI 原型设计工具中实现可控的代码生成具有巨大潜力。” 当开发者可以通过组件树掌控整个 UI 生成的过程,AI 生成工具终于摆脱了 “一次性输出” 的局限,真正成为了开发者可以灵活掌控的辅助工具。未来,这套方案很有可能会融入 Xcode 的更新中,成为苹果直观编码能力的一部分,为应用开发者带来更高效的原型设计体验。

为此,苹果的研究团队提出了 SafetyPairs 框架,相关研究成果发布在《SafetyPairs:通过反事实图像生成分离关键安全图像特征》的论文中。这套框架的核心,是通过 “反事实图像对” 来训练 AI 的安全识别能力。

简单来说,研究人员会构建大量的图像对:这两张图片几乎完全一致,唯一的区别,就是和安全策略相关的细微特征 —— 这个区别,会直接翻转这张图片的安全评级。比如,其中一张图片里的人物比了竖中指的不当手势,另一张则是正常的手势;又或者,两张图片里的同一栋建筑,一张是完好的,另一张则是正在燃烧的暴力场景。

研究结果显示,SafetyPairs 这套方法,不仅能有效发现当前最先进的视觉语言模型存在的安全弱点,还能作为一种高效的数据增强策略,用很少的样本就能训练出性能优秀的安全防护模型。