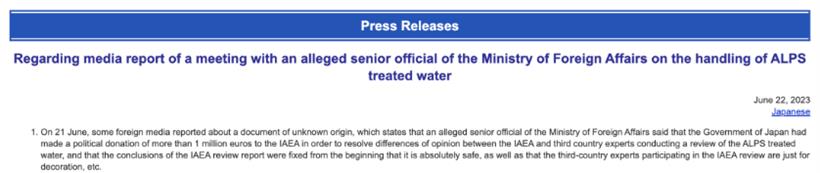

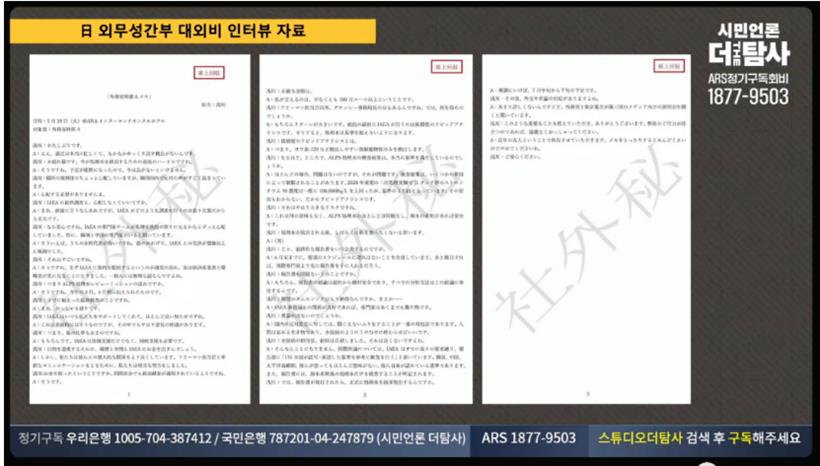

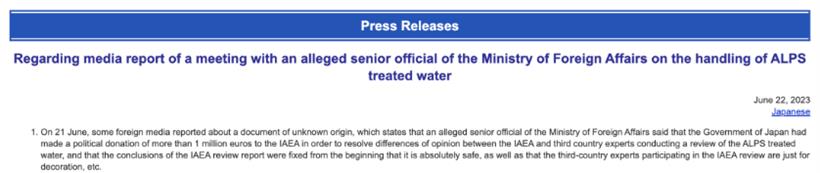

这几天,日本正式开始向太平洋排放核污染水的消息,引起了广泛的关注。而就在排放之前,有媒体报道称,日本政府从去年起便开始利用AI工具监控任何与福岛核电站计划排放核污水有关的言论。今年6月,该AI发现了一份韩国媒体的报道,声称日本外务省高级官员向国际原子能机构(IAEA)进行了巨额政治献金。

短短几个小时之内,日本政府便做出回应,同时用英文和日文驳斥该报道「毫无根据」。

根据Nikkei Asia此前的报道,日本外务省在2023年推出了一套全新的AI系统,用于收集和分析社交媒体等平台上的信息,以及在中长期内对公众舆论影响的追踪。值得注意的是,该框架不仅包括面向日本受众的信息,还包括其他国家和地区针对日本的信息。

事件回顾

2011年3月,地震和海啸摧毁了福岛第一核电站的冷却系统,导致三个反应堆中的核燃料熔毁,放射性物质不断泄漏。随之而来的大面积污染,迫使数万人撤离。为了抑制爆炸后过热的反应堆堆芯,自那以后,已经有超过130万立方米的海水被用于冷却。这些受污染的水也被收集起来,并存储在该场地上的1000多个不锈钢储罐中。

在造成污染的64种放射性元素中,主要对人类健康构成威胁的放射性元素为:碳-14,碘-131,铯-137,锶-90,钴-60和氚-3。为了处理这些核污水,东京电力公司(TEPCO)采用了自行研发的先进液体处理系统(ALPS),过程分为共沉淀、吸附和物理过滤等五个阶段。

然而,如此大量的水也让持续的储存变得越来越困难。2021年4月,日本政府正式批准将这些经过处理的核污水排入大海。尽管多个国家和国际组织对此表示担忧,但这并没有阻止日本对该计划的推进。与此同时,日本外务省也开始使用AI来监控网上关于核污水中含有放射性物质的报道,并通过制作大量宣传材料来稀释这些信息的浓度。

7月21日,日本外务省在推特上发布的一则动画视频,就用日语、英语、法语、西班牙语、俄语、阿拉伯语、中文和韩语,解释了核污水处理过程中采取的安全防护措施。

视频解释了工厂的水如何通过高级液体处理系统(ALPS)按照监管标准进行净化。并且强调,在被释放到更广泛的海洋区域之前,排放的核污水已经被海水稀释了100倍。

AI监控言论

实际上,这种监控互联网舆论的技术,在AI领域早已有了非常深入和广泛的探索。其中最为热门的,便是利用算法、机器学习模型和人工的组合来应对社交媒体中发布的「虚假新闻」。2018年的一项Twitter研究显示,虚假新闻报道被人类转发的可能性比真实新闻高70%。与此同时,真实新闻需要大约6倍的时间才能在1500人的群体中传播,而且大部分时候的传播范围很少能超过1000人。相比之下,热门的虚假新闻却可以传播到多达10万人。

为此,Meta曾在2022年推出过一款全新的AI工具Sphere,用来确保信息的准确性。Sphere是第一个能够一次性扫描数十万引用,来检查它们是否支持相应声明的AI模型。Sphere的数据集包括1.34亿个公共网页。它依靠互联网的集体知识来快速扫描数十万条网络引用,以寻找事实错误。

Meta表示,Sphere已经扫描了维基百科上所有页面,以此来检测它是否能够找出并不支持页面中声明的引用来源。当Sphere发现可疑来源时,就会推荐更强大的来源或更正,来帮助提高条目的准确性。此前,就有不少AI系统能够识别出缺乏引用来源的信息,但Meta的研究者表示,挑出可疑的说法并确定引用来源是否真正支持这种说法,需要「AI系统的深度理解和分析」。

Sphere的研发,标志着Meta为解决平台上的错误信息所做的努力。几年来,Meta一直因为Facebook、Instagram和WhatsApp上传播的错误信息,遭受着用户和监管机构的严厉批评。CEO小扎甚至被召到国会面前讨论这个问题。

发现假新闻,探索社交媒体传播模式

在欧洲,还有一个Fandango项目,他们在构建软件工具,帮助记者和事实核查员检测假新闻。无论是PS还是DeepFake,Fandango的系统都可以对这些变化进行逆向工程,使用算法帮助记者发现被篡改的内容。另外,系统还会根据已经被事实核查员标记的假消息,寻找到具有类似词语和观点的网页或者社交媒体帖子。

这个系统的背后,就是各种AI算法的支持,尤其是自然语言处理。而瑞士卢加诺大学和英国伦敦帝国理工学院教授Bronstein,则采用一种非典型的AI方法来检测假新闻。这个项目叫做GoodNews,颠覆了传统的假新闻AI探测工具。在以往,这些工具会分析假新闻特有的语义特征,然而它们会经常遇到障碍,比如WhatsApp这类平台是加密的,并不允许访问。

另外,很多时候假新闻可能是图像,使用自然语言处理技术很难进行分析。因此,Bronstein教授的团队颠覆了传统的模型,转而研究假新闻是如何传播的。

结果表明,假新闻在Facebook上的分享量可能远远多于点赞数,而普通帖子的点赞数往往多于分享量。通过发现这样的模式,GoodNews就会将可信度分数附加到新闻项目上。

团队的第一个模型使用基于图形的机器学习,基于推特的数据训练,上面的某些消息被记者证明是虚假的。由此,他们训练了AI算法,教会模型哪些故事是假的,哪些不是。

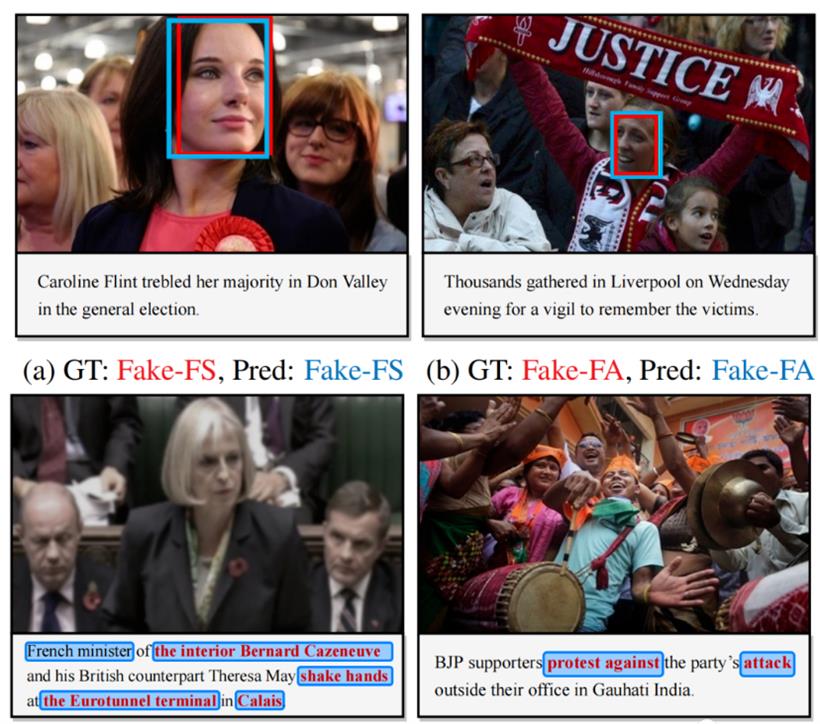

多模态DeepFake检测,让AIGC伪造无处可藏

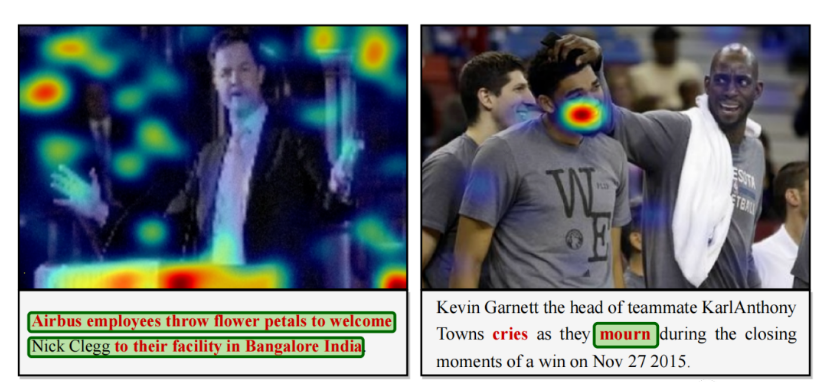

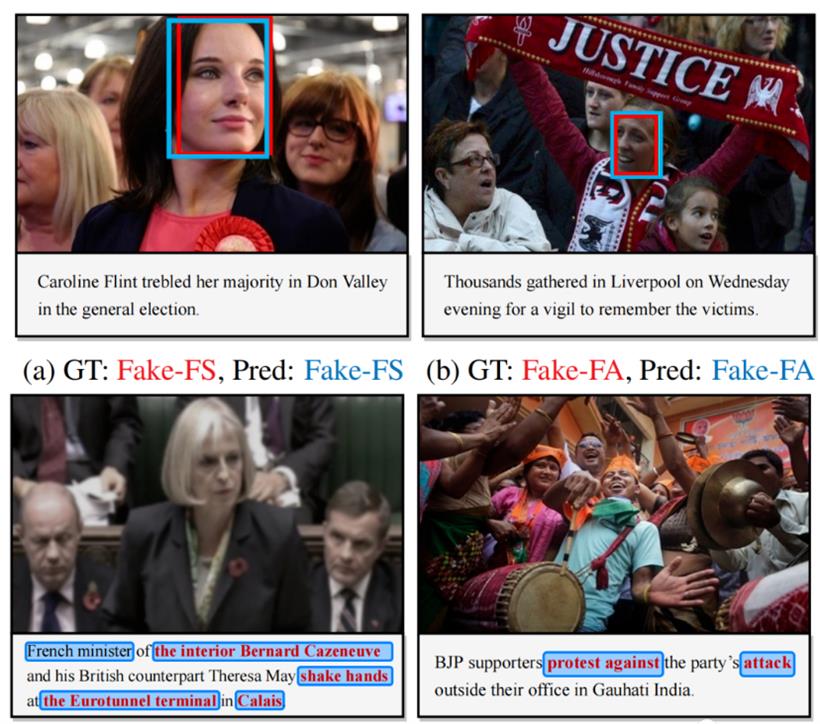

除了单纯的文本外,如Stable Diffusion等视觉生成模型的快速发展,也让DeepFake问题愈发严峻。在多模态媒体篡改中,各类新闻报道的图片中重要人物的人脸(下图中法国总统人脸)被替换,文字中关键短语或者单词被篡改(下图中正面短语「is welcome to」被篡改为负面短语「is forced to resign」)。

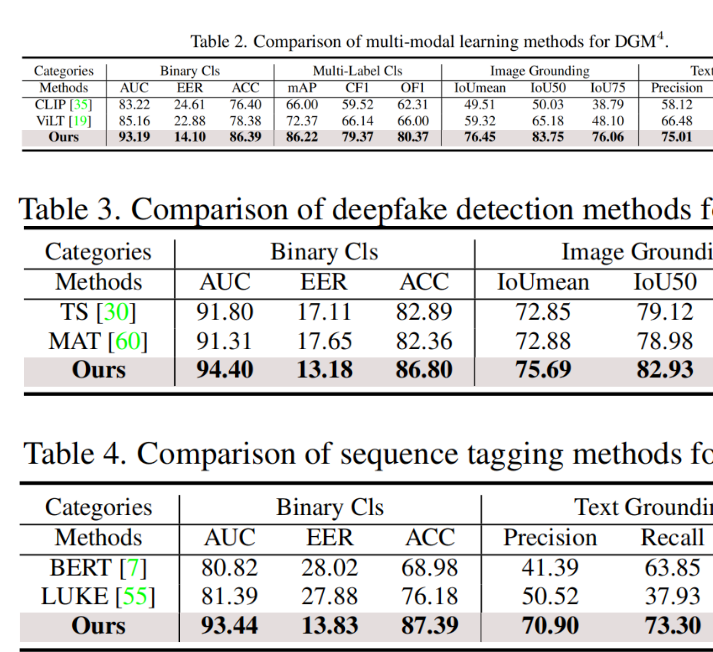

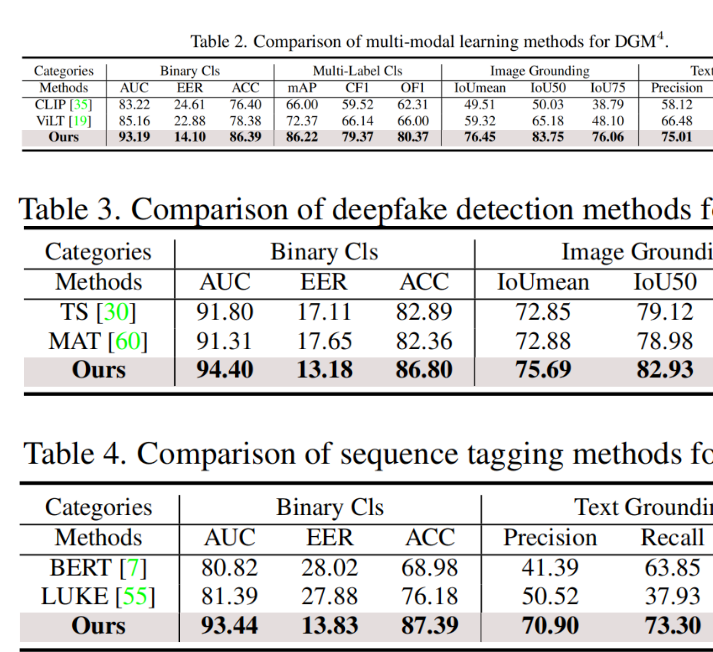

为了应对新的挑战,研究人员提出了一种多模态层次化篡改推理模型,可以通过融合与推理模态间的语义特征,来检测到篡改样本的跨模态语义不一致性。

目前,该工作已被CVPR 2023收录。

具体来说,作者提出了多模态层次化篡改推理模型HierArchical Multi-modal Manipulation rEasoning tRansformer(HAMMER)。

此模型建立在基于双塔结构的多模态语义融合与推理的模型架构上,并将多模态篡改的检测与定位细粒度层次化地通过浅层与深层篡改推理来实现。

HAMMER模型具有以下两个特点:

1. 在浅层篡改推理中,通过篡改感知的对比学习(Manipulation-Aware Contrastive Learning)来对齐图像编码器和文本编码器提取出的图像和文本单模态的语义特征。同时将单模态嵌入特征利用交叉注意力机制进行信息交互,并设计局部块注意力聚合机制(Local Patch Attentional Aggregation)来定位图像篡改区域;

2. 在深层篡改推理中,利用多模态聚合器中的模态感知交叉注意力机制进一步融合多模态语义特征。在此基础上,进行特殊的多模态序列标记(multi-modal sequence tagging)和多模态多标签分类(multi-modal multi-label classification)来定位文本篡改单词并检测更细粒度的篡改类型。

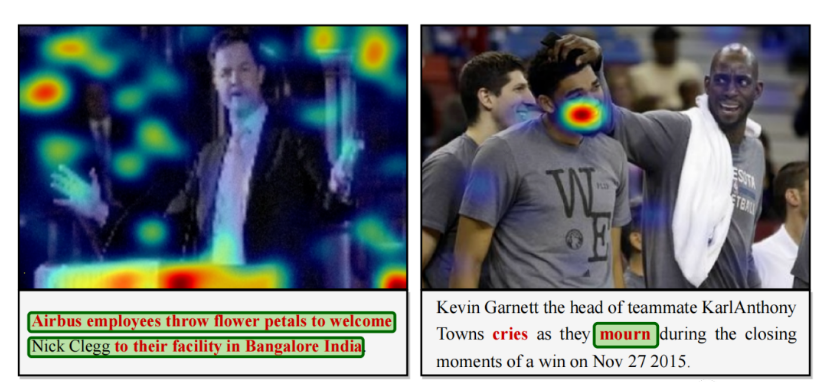

实验结果表明研究团队提出的HAMMER与多模态和单模态检测方法相比,都能更准确地检测并定位多模态媒体篡改。

从多模态篡改检测和定位的可视化结果来看,HAMMER可以准确地同时进行篡改检测与定位任务。

此外,关于篡改单词的模型注意力可视化结果,进一步展示了HAMMER是通过关注与篡改文本语义不一致性的图像区域来进行多模态篡改检测和定位。

参考资料:

https://asia.nikkei.com/Business/Technology/Japan-taps-AI-to-defend-against-fake-news-in-latest-frontier-of-war#

https://asia.nikkei.com/Business/Technology/Japan-deploys-AI-to-detect-false-info-on-Fukushima-water-release

https://www.youtube.com/watch?v=jrM0mw8gp-Y

https://www.mofa.go.jp/press/release/press1e_000443.html

https://tech.facebook.com/artificial-intelligence/2022/07/how-ai-could-help-make-wikipedia-entries-more-accurate/

https://arxiv.org/abs/2304.02556

https://arxiv.org/abs/1902.06673

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号