近日,AI 芯片巨头英伟达(NVIDIA)宣布推出全新NVIDIA RTX 500 和 1000 Ada一代消费级GPU(图形处理器)加速芯片,全面支持在轻薄笔记本电脑等移动设备中运行生成式AI(AIGC)软件。

英伟达表示,与仅使用CPU的配置相比,全新RTX 500 GPU可为Stable Diffusion等模型提供高达14倍(1400%)的生成式 AI 性能,利用 AI 进行照片编辑的速度提高3倍,3D渲染的图形性能提高10倍,从而成功实现了生产力的巨大提升。作为入门款GPU产品,英伟达RTX 500将成为全球内置AIGC技术且价格最便宜的GPU芯片。

同时,这也意味着,黄仁勋持续降低AI PC设备门槛,即将大量出货英伟达GPU芯片,消费者买笔记本电脑免费送 AI 的时代真的要来了!

据悉,英伟达RTX 500和RTX 1000均采用与RTX 4090、L40服务器GPU一样的Ada Lovelace架构,或采用台积电4N(5nm)工艺,拥有神经处理单元 (NPU)、第三代 RT 核心、第四代Tensor Core、Ada一代CUDA内核、专用GPU内存、DLSS 3光线追踪技术、第八代 NVIDIA AV1(NVENC)编码器等一系列旗舰 AI 芯片才拥有的重要配置。

英伟达称,随着AIGC和混合工作环境成为新标准,无论是内容创建者、研究人员还是工程师,几乎每位专业人士都需要一台强大 AI 加速功能的笔记本电脑来帮助用户应对行业挑战。而RTX 500 和 1000 GPU 通过 AI 为各地紧凑型设计的笔记本电脑用户提升工作流程。

具体来说,首先,基于NVIDIA Ada Lovelace 架构,RTX 500 和 1000 GPU芯片拥有第三代 RT 核心,光线追踪性能比上一代提升了2倍,可实现高保真、逼真的渲染。

其次,搭载的第四代 Tensor Core AI 加速技术,吞吐量是上一代的 2 倍,可应用于深度学习训练、推理和基于 AI 的创意工作负载。

再次,与上一代相比,拥有最新CUDA内核的RTX 500 和 1000 GPU,单精度浮点 (FP32) 吞吐量提高30%;而第八代 NVIDIA 编码器支持 AV1,效率比 H.264 高出 40%。

最后,RTX 500 GPU 配备 4GB GPU专用内存,RTX 1000 GPU 配备 6GB GPU专用内存,可处理更大的项目、数据集和多应用工作流程,全面支持部分复杂3D场景和 AI 应用研发。

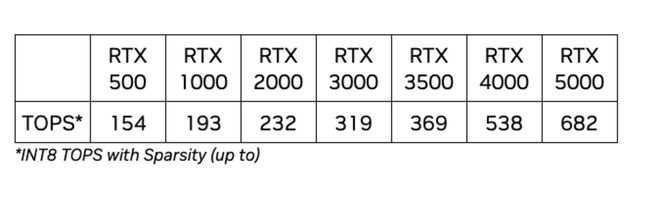

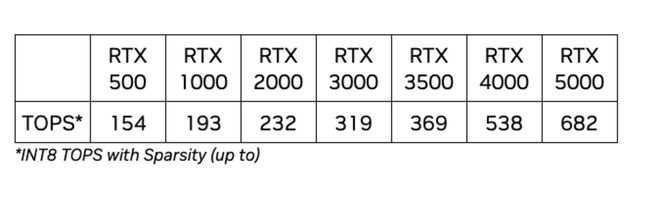

另外,内置NPU的RTX 500 和 1000 GPU芯片,可提供最高193 TOPS 的 AI 性能,满足日常 AI 工作流程。如果你希望利用 AI 来实现深度学习、数据科学、高级渲染等工作流程,英伟达还提供 RTX 2000、3000、3500、4000 和 5000 Ada笔记本电脑 GPU,最高支持682 TOPS 的 AI 性能。

很显然,黄院士的想法就是:一旦要用 AI,就要买英伟达GPU显卡。没有更高性能的CPU难以开发和使用 AIGC 应用程序。

“你买的越多,你省的就越多。”黄仁勋曾表示。(You buy the more, You save the more)

英伟达透露,全新 NVIDIA RTX 500 和 1000 Ada 一代笔记本电脑 GPU 将于今年春天在戴尔、惠普、联想和 MSI 等移动工作设备中应用。实际上,钛媒体App编辑手中的一台Redmi Book 15E,由于没有内置NVIDIA独立显卡。因此,我们安装很多支持CUDA如NVIDIA App等多款 AI 应用就会显示“安装无法继续”——GPU已深深改变了我们的生活。

近期公布的英伟达最新财报显示,2024财年,英伟达营收609.22亿美元,同比增长126%;净利润同比增长581%,至297.60亿美元,成为地表最强的公司。

受利好业绩影响,英伟达美股持续大涨

2023年,英伟达股价已累计上涨236%,进入2024年英伟达股价短短两个月涨幅又超过63.05%,最新市值在2万亿美元左右。如今,新的 AI 时代下,全球科技巨头排行发生了重大变化:英伟达超越了谷歌、亚马逊等一众巨头,已成为全球第三大科技公司,仅次于微软、苹果。

随着股价暴涨,英伟达联合创始人兼CEO黄仁勋身价也水涨船高,最新增加85亿美元,至 681 亿美元,成为全球第21位最富有的人,不仅超越科赫工业CEO查尔斯·科赫(Charles Koch),而且也成功超过中国首富、农夫山泉创始人兼董事长钟睒睒。

对于中国市场,英伟达也首次提到,华为是英伟达最重要的竞争对手之一。同时,黄仁勋对外确认,英伟达正在向客户提供A100/H800 AI 芯片的替代样品,同时遵守了美国商务部半导体出口管制规定。

黄仁勋最近接受《Wired》对话时坦言,华为是非常好的公司。尽管他们受到现有半导体处理技术的限制,但他们仍然可以通过将许多芯片聚集在一起来构建非常强大的系统。黄仁勋强调,英伟达非常期望去中国市场进行业务竞争,并希望“我们能够成功地服务于市场”。

2月26日晚,美国存储芯片巨头美光科技(Micron Technology)宣布,该公司已开始批量生产其用于AI加速的先进Micron 24GB HBM3E内存方案,提供高达1.2 TB/s带宽,相比竞争对手功耗降低30%,应用于英伟达H200 Tensor Core GPU,最快将于2024年第二季度出货。

随着英伟达A100、H100芯片的成功量产,英伟达正瞄向 AI 超算云Nvidia DGX Cloud、AI 软件栈Nvidia AI Enterprise等全新业务。

黄仁勋早前表示,生成式 AI 使每个(软件)企业都拥抱加速计算,提高吞吐量,而英伟达将利用Nvidia AI Enterprise,对这些企业所有的软件堆栈进行管理、优化、修补。而谷歌成为了Nvidia AI Enterprise的最新合作方。

“我们将其推向市场的方式是将 Nvidia AI Enterprise 视为操作系统,每年每个 GPU 收取 4500 美元。我的猜测是,世界上每一家在专有云和私有云中部署软件的软件企业公司,都将在 Nvidia AI Enterprise 上运行。”黄仁勋表示。

半导体行业机构 Futurum Research 首席执行官丹尼尔·纽曼 (Daniel Newman) 认为,“英特尔曾经是业界的霸主。而现在,很多公司正联合起来,以确保英伟达不会变得太强大。”

综合多方消息,3月18日举行的GTC大会上,英伟达将推出基于下一代Blackwell GPU架构的新款B100 AI芯片,采用台积电3nm制程工艺、三星提供最新HBM存储技术,据推测B100性能至少是H200的两倍、也就是H100的整整四倍,预计B100将成为全球最强大的 AI 芯片。

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号