- 联系我们

- duidaima.com 版权声明

- 闽ICP备2020021581号

-

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

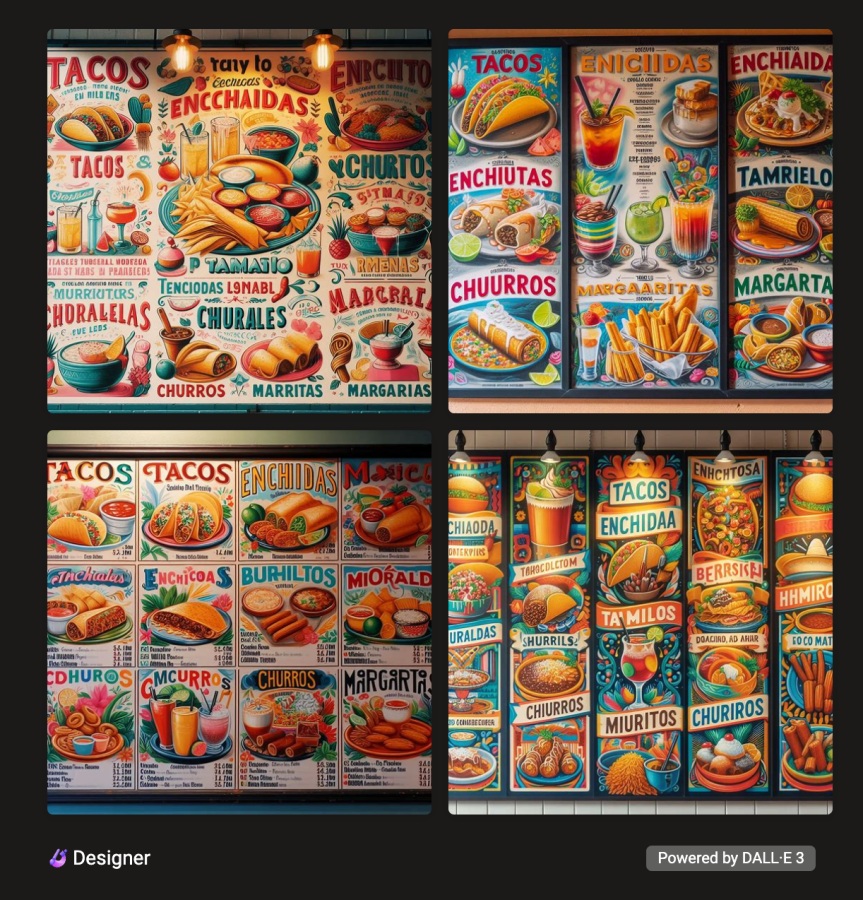

堆代码讯 两年前,想要用 AI 图像生成工具制作一份墨西哥餐厅的菜单,最终得到的只会是一堆充满拼写错误的虚构菜品 —— 模型会凭空造出 “enchuita”“churiros” 这类根本不存在的美食,让这份菜单完全无法投入使用。而如今,OpenAI 全新推出的 ChatGPT 图像 2.0,已经彻底改变了这一局面:当用户向新模型索要一份墨西哥食物菜单时,它生成的内容已经可以直接打印出来给餐厅使用,顾客甚至根本不会察觉到这是 AI 的作品,唯一可能引发怀疑的,或许只有 13.5 美元一份的酸橘汁腌鱼的定价。

这场肉眼可见的进步,背后是 AI 图像生成技术的跨越式升级,也标志着 AI 生图终于从 “能看” 迈入了 “能用” 的实用阶段。

AI 图像生成器的文字短板,曾是行业多年来的痛点,而这一问题的根源,在于过去主流的扩散模型的工作逻辑。扩散模型的核心原理是从随机噪声中逐步重建图像,在这个过程中,图像里的文字只占了极小一部分的像素。正如 Lesan AI 的创始人兼 CEO Asmelash Teka Hadgu 在 2024 年解释的那样:“我们可以认为图像上的文字只占非常非常小的一部分,因此图像生成器学习的是覆盖更多像素的模式。” 这就导致模型很难精准学习到文字的细节,最终生成的文字往往扭曲、错漏,甚至完全是乱码。

为了解决这一问题,研究人员开始探索全新的图像生成机制,比如自回归模型 —— 这类模型的运作方式更像大语言模型,通过逐步预测图像的内容来构建画面,能够更好地理解内容的结构与逻辑,而非单纯的像素模式。尽管在本周的发布会上,OpenAI 拒绝透露 ChatGPT 图像 2.0 具体采用了何种模型架构,但行业普遍猜测,新模型已经摒弃了前代 DALL-E 系列的扩散架构,转而采用了自回归多模态架构,这也正是它能够完美解决文字渲染问题的核心原因。根据 OpenAI 的介绍,新模型对日语、韩语、印地语、孟加拉语等非拉丁文字的渲染理解能力也有了显著提升,彻底打破了过去 AI 生图对多语言文字的支持短板。

除了文字能力的突破,ChatGPT 图像 2.0 最引人注目的升级,是它首次拥有了 “思考能力”。OpenAI 介绍,新模型不再像过去的生图工具那样,拿到提示词就直接输出图像,而是会先进行一系列的准备工作:它可以联网搜索网页获取实时信息,能够根据用户的需求规划图像的结构,甚至在生成完成后对结果进行自我复核,修正其中的错误。

目前,ChatGPT 图像 2.0 已经正式向用户开放:从周二开始,所有 ChatGPT 和 Codex 用户都可以使用这一新功能,而付费用户还能解锁更高级的输出能力。同时,OpenAI 也推出了对应的 gpt-image-2 API,开发者可以将这一能力集成到自己的产品中,API 的定价将根据输出的质量和分辨率进行调整。对于整个行业而言,这次升级的意义远不止是让 AI 能写对字:过去的 AI 生图,更多是用于创作观赏类的艺术作品,而现在,它已经能够胜任商业场景的实用需求 —— 餐厅的菜单、企业的营销海报、产品的 UI 设计、信息图表,这些过去需要专业设计师完成的工作,如今 AI 已经可以高效完成。