- 联系我们

- duidaima.com 版权声明

- 闽ICP备2020021581号

-

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

产品同学对业务的诉求进行需求评审,和业务侧描述基本相同。但产品考虑到虚拟商品存在复购的需求,增加了时间限制,例如一周允许用户购买几次、一天允许用户购买几次。

小美和产品沟通需求后,开始着手方案设计。虽然产品功能的描述比较简单,一天或一周允许用户购买某类商品几次,但业务后续往往会不断增加新特性,如果不进行前瞻性设计,未来无法承接新需求,可能要重新设计限额系统,所以第一次设计时要尽量设计的更通用,扩展性更强。

经过头脑风暴,小美打算设计一个扩展性极强的限额系统,一方面是产品和业务诉求的不断变化要求系统扩展性要强,另一方面,小美通过深刻的思考,意识到限额能力具备通用性,可以进行抽象封装,提高扩展性。

小美认为限额能力可以基于Redis进行设计,借助于LUA脚本可以满足一致性问题,同时解决了秒杀热点等性能问题。至于Redis可能丢数据的风险,她也进行了思考。线上环境的Redis集群有毫秒级的主从同步,从节点和主节点只有毫秒级的数据差异。就算主节点挂了,丢数据了,也仅仅只影响几秒钟的限额数据,切换到从节点,限额接口可以继续使用。所以小美认为Redis丢失数据的风险可控。

小美考虑到要对 UserId、UUID、手机号等维度进行限额。自然要使用UserId、UUID/Phone等作为Redis Key,但是考虑到,尽可能减少Redis大Key,小美想把以上维度值放到 Redis hash field中。

是否可行呢?小美深入思考后认为不可行。小美想到用户可能的购买场景,例如用户注销后再注册,同一个手机号绑定了多个userId,使用新号购买,系统查询购买次数时,只知道UserId、Phone。 如果把UserId/Phone放到Redis Hash Field中,那么Redis Key是什么呢?

所以只得把限额维度UserId、Phone等作为Redis大Key 设计。

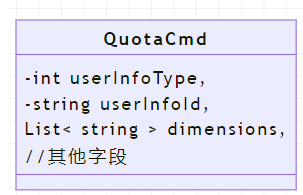

系统要提供用户维度和商品维度在存储上的灵活性,最好不要限制其他维度的编码格式。只需要上游传dimensions,自动拼接在Redis Key之后,小美认为这样扩展性会非常强。

接下来,小美踌躇很久,如何保证扣减的一致性,十分困扰。

小美在两个方案之间很是纠结,这两个方案都可以实现限额,但是开发成本都不低,拿Lua脚本来说,LUA脚本要分别对用户的UserId、UUID、手机号等 KEY 进行判断,判断成功后,再调用三个Key的 incrBy增加购买次数。这个LUA脚本写起来,可是真的复杂啊。

并且还存在一个更加致命的问题!!由于公司的Redis集群使用Redis Cluster结构,会进行Redis Key的分片。用户一次购买生成的限额 key不一定能保证在同一个Redis节点?所以LUA脚本压根就不行啊。

再考虑方案2,先试探性增加购买次数,如果超过限额就回滚。这个方案也非常复杂,如果只有一个Key,回滚也就算了,可以这么干。但是限额场景Key的数量太多,使用这个方案,编码复杂度会增加。并且如果出现超时怎么办呢?例如扣减限额的第三个命令,超时了,你怎么知道扣减是成功还是失败?又如何回滚前两个限额呢?

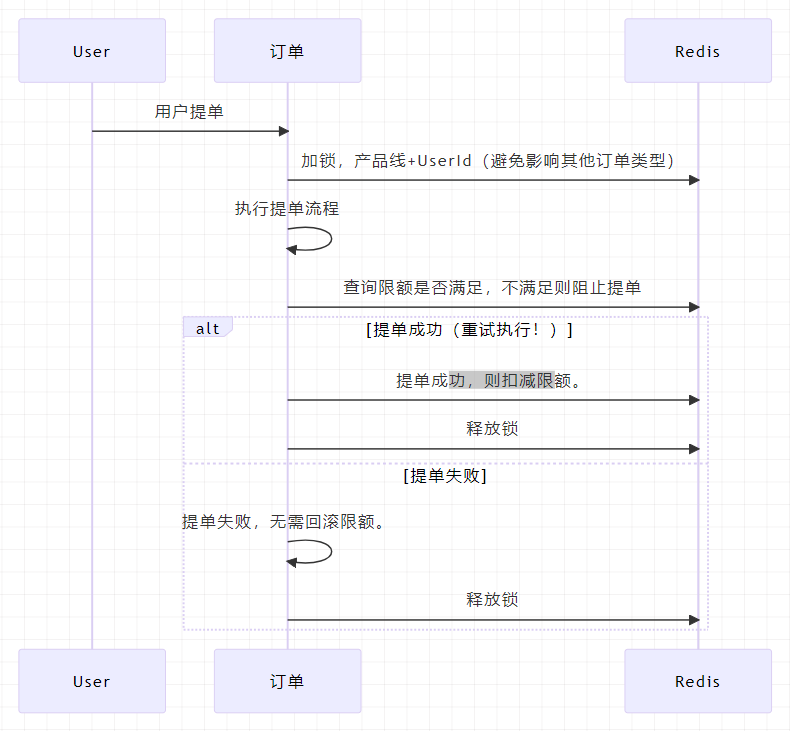

在提单流程之前,加一把用户锁,需要和其他订单系统隔离开,不影响其他订单类型提单。这样用户的并发提单行为被限制。同一个用户并发提单一般是因为频繁点击、重试等引起的。加一把锁,可以保证提单前、提单中、提单成功这一过程在用户维护是串行处理,不存在并发行为,简化了代码设计。

由于有了用户提单锁的存在,提单前先校验限额是否充足,充足则进行提单。提单成功以后扣减限额,如超时则重试。当然重试要保证扣减的幂等。可以使用订单Id作为幂等键,存在Redis中,如果存在扣减记录,就不再更新。由于重试操作时间很短,幂等键超时时间设置为10分钟即可。可避免长时间存在Redis中,占用内存。

小美对自己全新的设计感到很满意,通过引入一个分布式锁,居然可以极大的简化系统设计。不再需要考虑用户并发行为等极端场景。换了一个思路,由提单前扣减限额到提单成功才扣减限额。提单失败了,不需要考虑回滚限额啊。

于是小美想到库存扣减能不能也用这个思路?不行,商品的库存是全体用户争抢到的,加用户维度分布式锁没用,也很难给商品维度加分布式锁,总不能限制一个商品同时只有 1 个用户能提单吧。所以商品库存扣减还真的不能像限额似的,通过加用户提单锁,简化扣减资源流程。

王哥问小美:“你的限额系统可以同时支持用户维度、UUID维度、Phone维度三码限额。但是你的分布式锁只加了UserId维度,那么如果同一个手机号,在两个客户端,使用两个UserId并发提单,你的限额还能有用吗?”

小美差点闪了腰,对啊,限额明明是三个维度,三码限额,但是我只加了一个UserId维度的锁…… 难不成要加三个维度的锁,如何保证三个分布式锁的一致性获取呢? Redision有这个能力吗?小美飞快的思索着…… 非常紧张……

王哥看到小美沉默良久,"其实,我提的场景压根不会存在",王哥笑着,告诉小美,“……你逗我呢?”小美表面笑嘻嘻的回应,“差点翻车,幸亏有限制,要不然方案白写了”。心里在盘算着“你第2个问题,肯定也是在逗我。”

王哥认真说道:" 也不全是逗你,如果未来的限额要支持身份证号呢?我们可没法限制同一个身份证号,并发提单啊? 好在现在没有这个场景。未来如果有了,可能需要再加身份证号维度的分布式锁。到时候再看吧!”

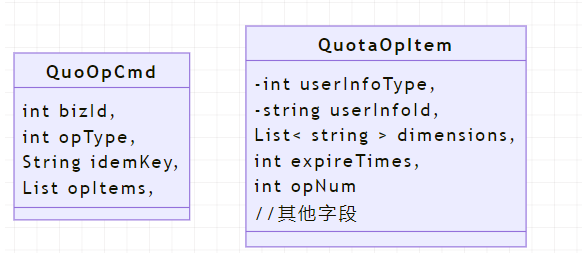

王哥 认真的继续补充,“第二个问题,其实是想告诉你,既然你使用了分布式锁控制了用户的并发行为,就没有必要再使用用原子化的扣减命令,为什么还要再使用incrBy增加购买次数呢? 使用set命令,设置新的购买次数,不是更好吗?”

“我明白了,我立马去改方案,王哥,你真神了”。小美话没说完,就秒懂王哥的思路,回去重新细化了方案,补充了以上两个问题的处理方案。

是的,既然已经引入了分布式锁,限制了用户并发提单,并发扣减库存的行为,也没有必要使用incrBy命令增加购买次数,为什么要用set 命令设置购买次数呢 ?王哥虽然没有明说,小美已经领会了意图,屏幕前小伙伴理解了吗?

使用set命令,如果出现了Redis超时等,可以无脑重试。但是IncrBy 命令则不然,无脑重试会导致多记录用户购买次数。而redis是支持 MSet命令的,即可以同时修改多个Key的Value,保证数据修改的原子性。

在MSET之前,先计算每个KEY的hash槽,选择对应的Jedis实例,也可以用MSET

虽然会同时调用多个Redis节点可能有超时,但考虑到外部有用户锁,不会有并发,MSET可以重试执行。不存在幂等问题,遇到超时等异常,可以无脑重试即可。

需求里可是要求可以限制用户一天的购买次数,小美和产品确认,一天限额是指 自然天,但未来不排除是24小时内的限额。但实际上无论是自然天,还是24小时,对系统的设计没有太大影响,小美是这样设计的。

“订单退款,需要回滚限额时,怎么设计呢?假如是自然天的限额,用户第一天买,第二天也买了,但是第一天买的退款了,我此时不能回滚第二天的限额啊。”

“哦,对了,订单退款时,限额组件判断一下,如果超过了限额的过期时间,无需再回滚限额了。”

从小美设计限额系统的思考过程、最终方案,我们可以作如下总结.