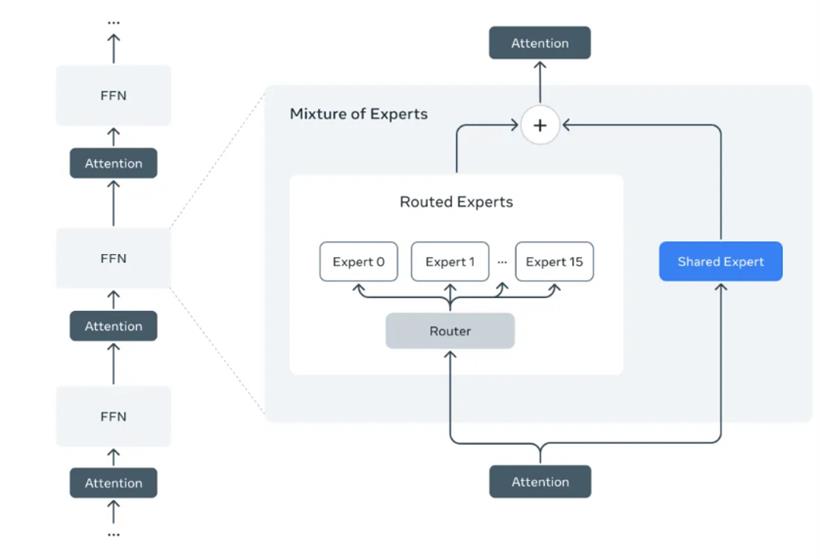

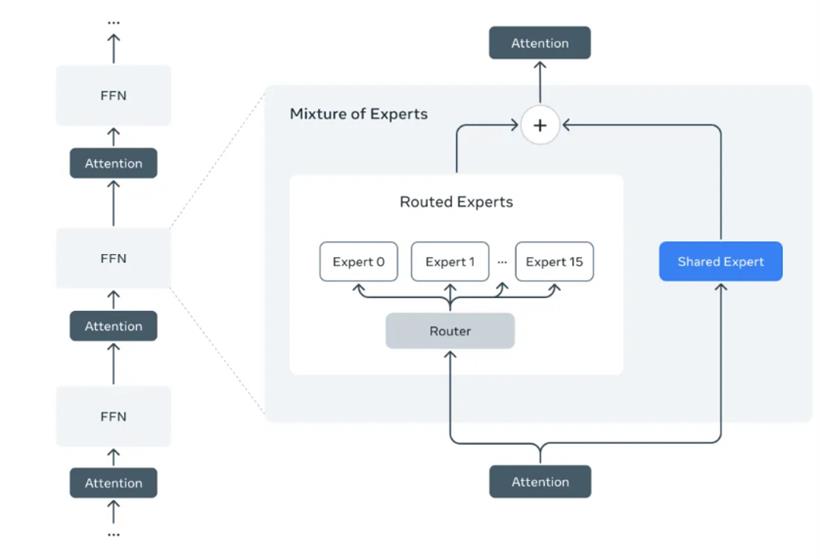

今天凌晨 Meta 终于发布了 Llama 4 系列模型。在 DeepSeek 发布开源模型后,Meta 沉寂了很长一段时间,还被爆出核心团队成员离职。今天小扎终于拿出来诚意作品 Llama 4 系列模型。Llama 4 是首批开放权重的原生多模态模型,支持超长上下文,是 Meta 首批采用混合专家(MoE)架构的模型。在 MoE 模型中,单个 Token 只激活总参数的一部分。这种架构在训练和推理时更省算力,而且在固定的训练计算量预算下,与密集模型相比,质量更高。

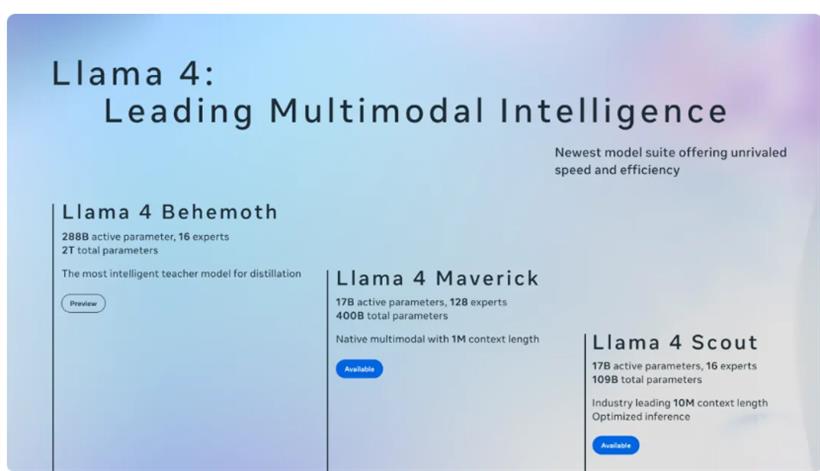

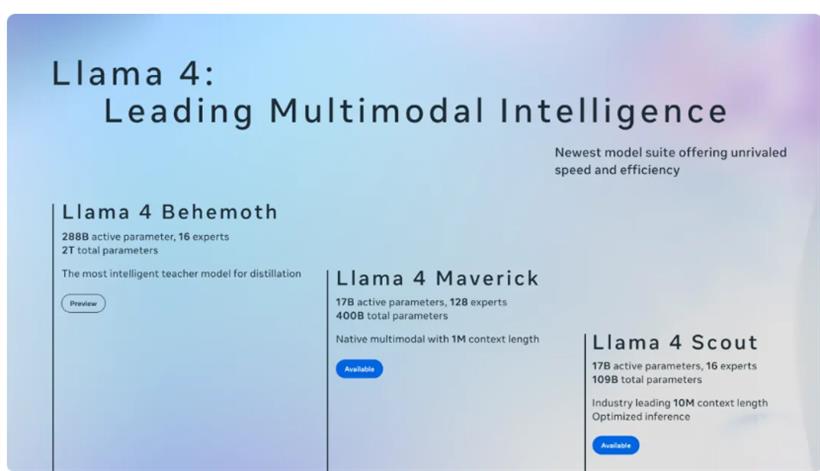

Llama 4 通过在 200 种语言上进行预训练来支持开源微调工作,其中包括 100 多种每种语言有超过 10 亿个 Token,总体多语言 Token 数量是 Llama 3 的 10 倍。这次 Meta 发布了 Llama 4 Scout 和 Llama 4 Maverick,并预览了 Llama 4 Behemoth。

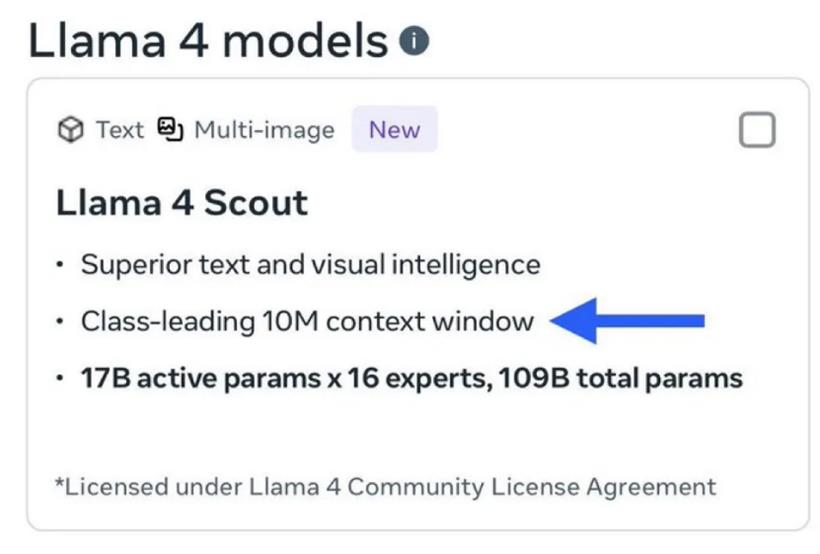

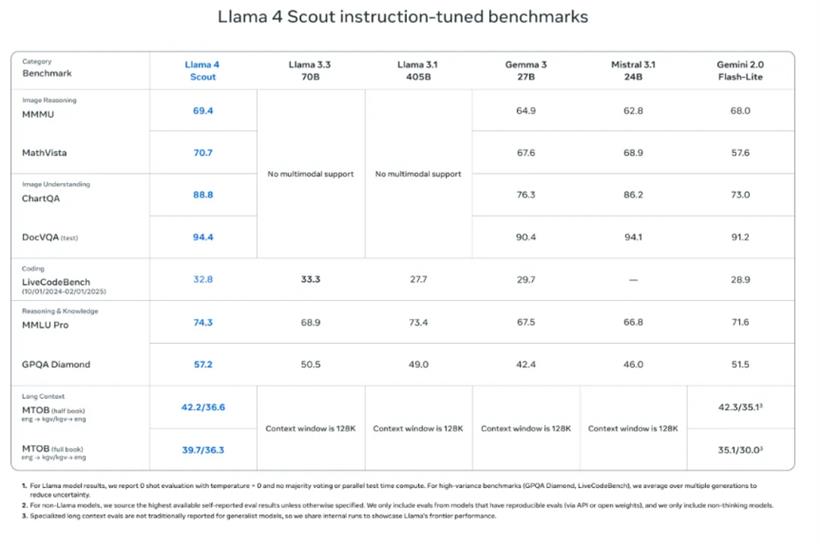

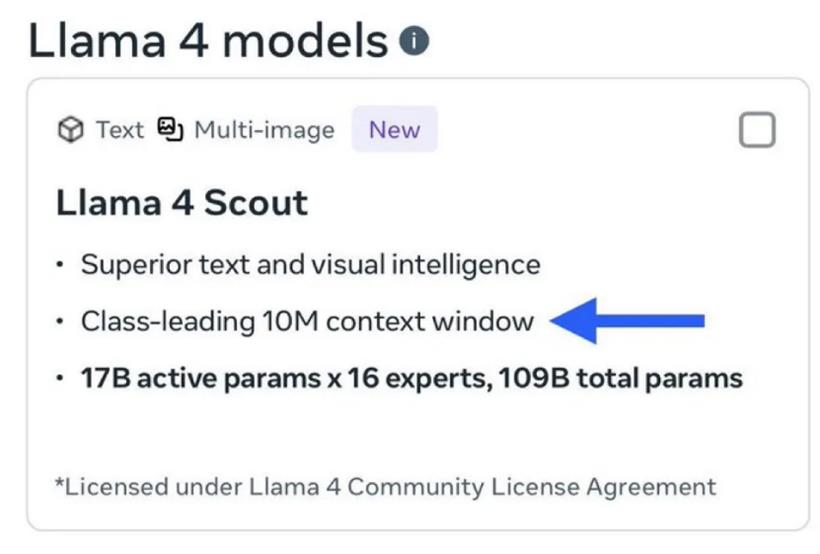

Llama 4 Scout 有 170 亿个活跃参数,分布在 16 个 “专家” 模型中,整体参数接近 1090 亿。是性能最强的小型模型,它的运行速度超快,天生支持多模态,而且非常智能。它实现了业界领先的 1000 万 + Token 上下文窗口,并且可以在单个 H100 GPU 上运行。

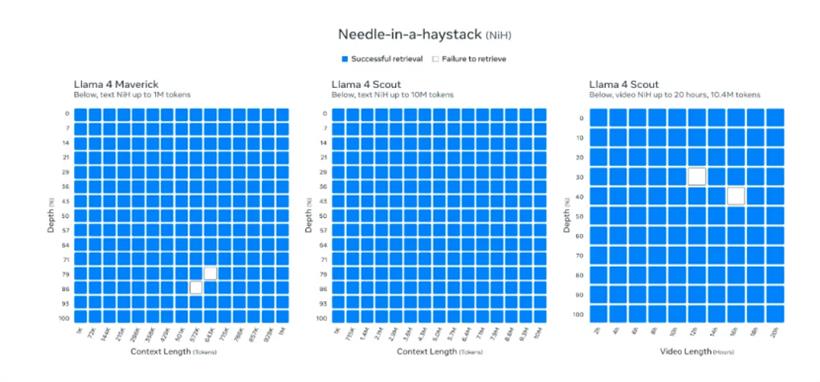

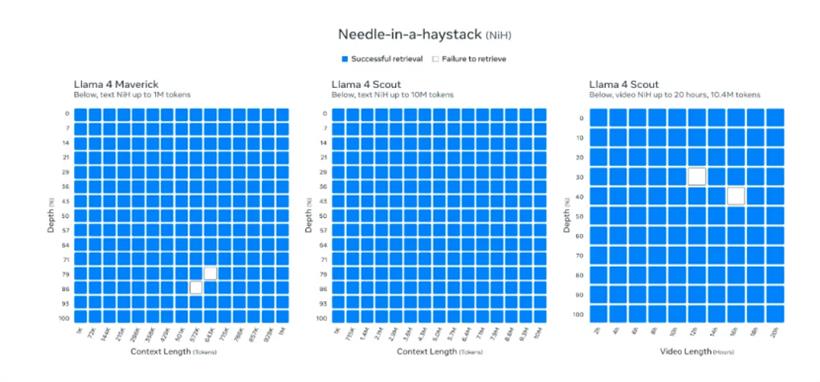

Llama 4 Scout 在预训练和后训练中都采用了 256K 的上下文长度,这让基础模型具备了超长上下文的泛化能力。它在像 “大海捞针” 这样的检索任务以及代码累积负对数似然(NLL)任务中都展示了很强的能力。

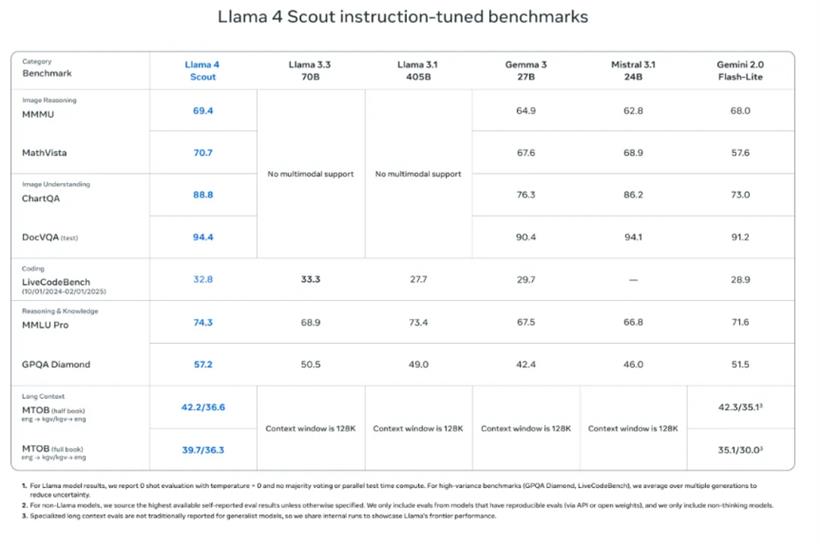

Llama 4 Scout 在编码、推理、长上下文和图像基准方面也超越了同类模型,并且比 Llama 之前所有的模型性能都强。

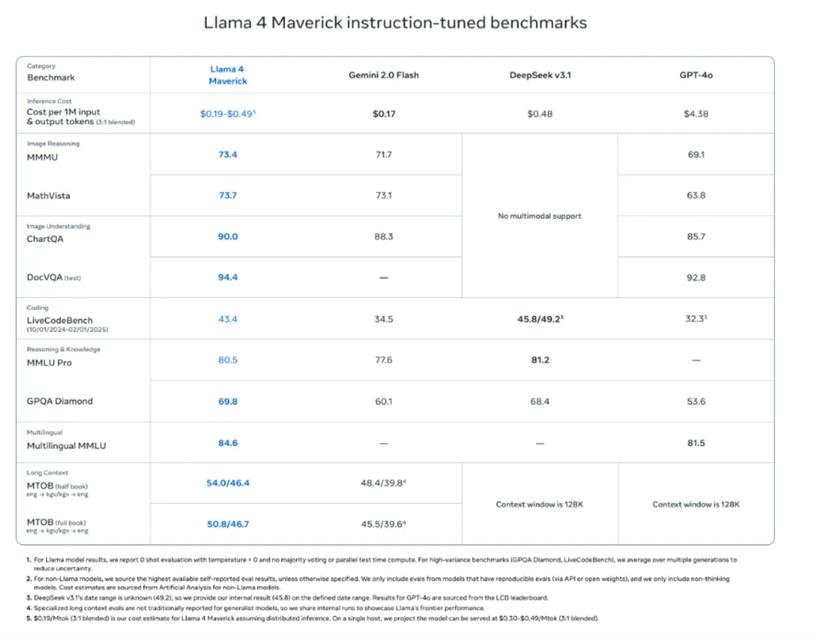

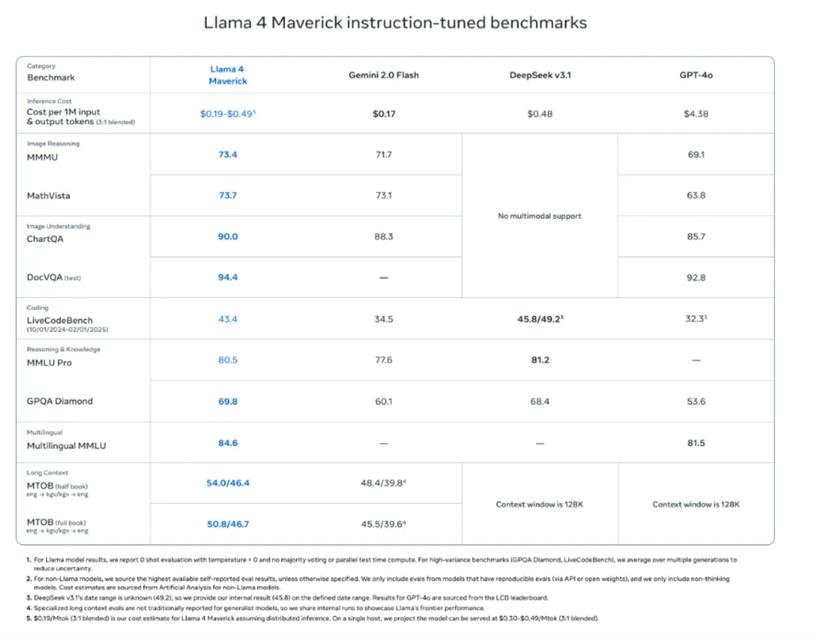

Llama 4 Maverick 包含 170 亿个活跃参数、分布在 128 位 “专家” 模型中,总参数高达 4000 亿,与 Llama 3.3 70B 相比,价格更低,性能更强,在编码、推理、多语言、长上下文和图像基准测试中超越了 GPT-4o 和 Gemini 2.0 Flash 等同类模型,在编码和推理方面可与最新发布的 DeepSeek v3.1 相媲美。Llama 4 Maverick 在图像和文本理解方面特别厉害,在行业里数一数二,能做出跨越语言障碍的高级 AI 应用。它在通用助手和聊天场景里表现很棒,特别适合精准的图像理解和创意写作。

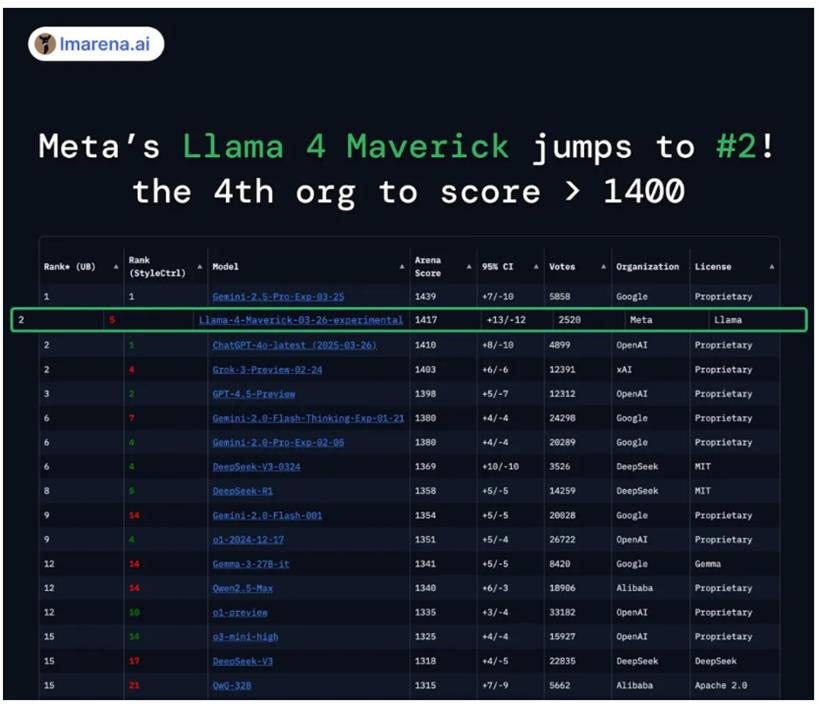

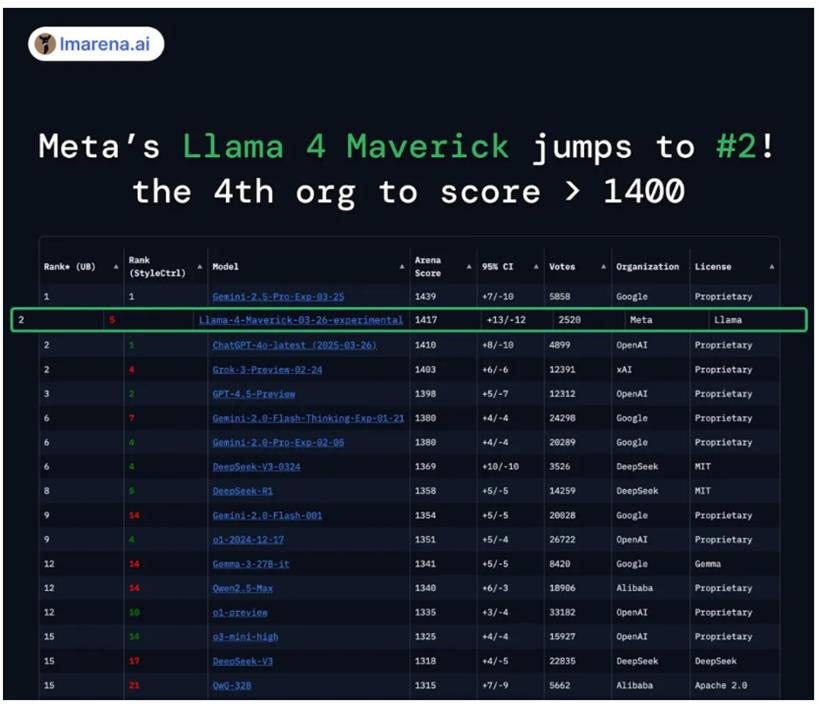

Llama 4 Maverick 的实验性聊天版本在 LMArena 上得分为 1417 ,排名第二,是第四个突破 1400 分的模型。

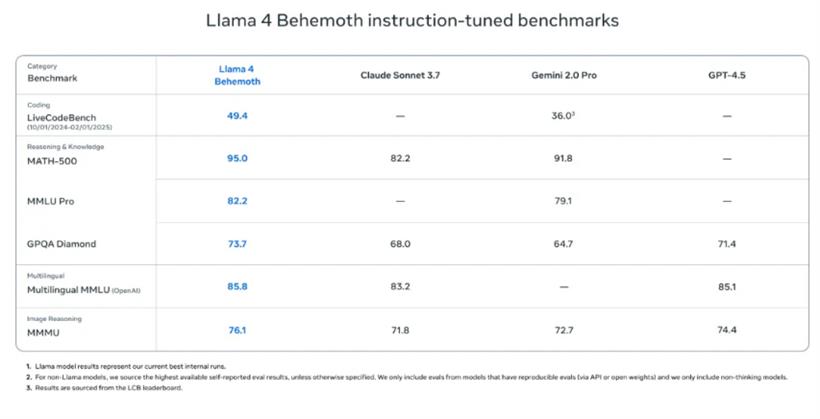

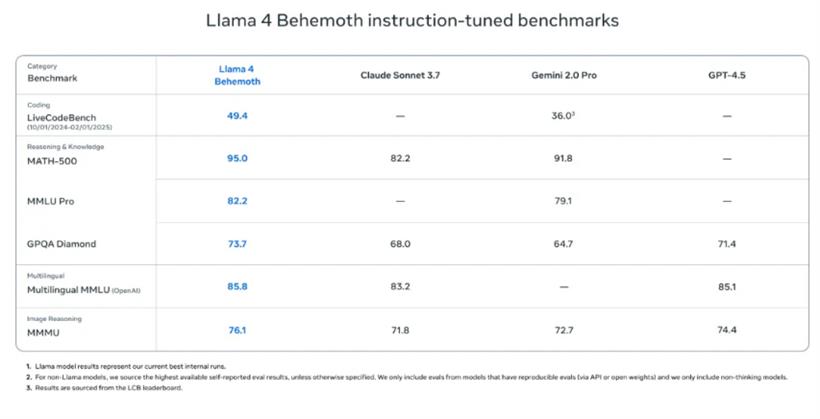

Llama 4 Maverick 可以在单个 NVIDIA H100 DGX 主机上运行,部署方便,可以通过分布式推理实现最高效率。Llama 4 Behemoth 是 Meta 截止目前最强大的模型,也是世界上最智能的大模型之一。在多个 STEM 基准测试中超越了 GPT4.5、Claude Sonnet 3.7 和 Gemini 2.0 Pro。Llama 4 Behemoth 仍在训练中。

现在,Llama 4 Scout 和 Maverick 已经可以在 llama.com 和 Hugging Face 上下载,同时,也可以在 WhatsApp、Messenger、Instagram Direct 和 Meta.AI 网站上体验 Llama 4 的新功能。

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号