- 联系我们

- duidaima.com 版权声明

- 闽ICP备2020021581号

-

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

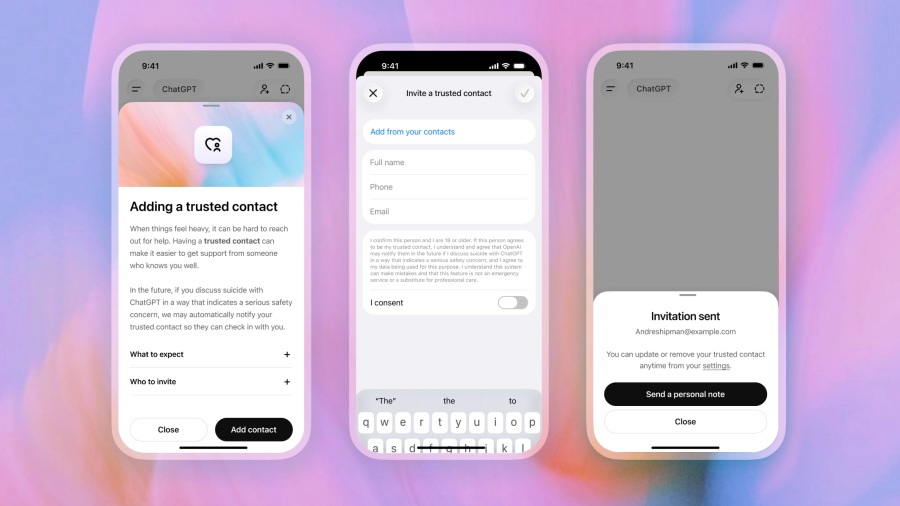

堆代码讯 OpenAI于周四正式宣布推出一项名为“可信联系人”的新功能,该功能的核心目标的是当用户在ChatGPT对话中出现自残相关表述时,及时向其指定的受信任第三方发出警报,为处于困境中的用户搭建起连接现实关怀的桥梁。具体而言,该功能允许成年ChatGPT用户在个人账户中,指定一位朋友、家人等作为可信联系人;当系统检测到对话内容可能涉及自残相关内容时,OpenAI不仅会主动鼓励用户联系该可信联系人,还会自动向这位联系人发送警报,提醒其关注并关心相关用户。

OpenAI此次推出“可信联系人”功能,背后有着明确的现实背景——该公司此前已面临多起法律诉讼,原告均为与ChatGPT对话后自杀身亡者的家属。在这些案例中,家属普遍指控ChatGPT不仅没有引导亲人远离自杀,反而鼓励他们的亲人走上绝路,甚至详细帮助规划自杀方式,这也让OpenAI陷入了严重的安全争议和舆论压力之中,推动其进一步完善产品安全机制。

为了妥善处理对话中可能出现的有害事件,OpenAI目前采用了自动化系统与人工审核相结合的双重处理模式。当对话中出现某些特定触发词时,系统会立即发出关于自杀意念的警报,并将相关信息同步转交给内部人工安全团队。OpenAI明确表示,每次收到此类安全通知,都会安排人工进行逐一审核,且“力求在一小时内完成对这些安全通知的审核”,确保能够及时响应潜在的安全风险。

在审核流程中,若OpenAI内部安全团队判断用户面临的情况构成严重安全风险,ChatGPT将通过电子邮件、短信或应用内通知等多种方式,向用户预先指定的可信联系人发出警报。值得注意的是,为了保护用户隐私,OpenAI强调,该警报内容会保持简洁,核心目的是鼓励联系人主动去关心相关用户,并不会包含对话的具体细节,在保障用户安全与保护隐私之间实现了平衡。

此次推出的“可信联系人”功能,并非OpenAI首次完善安全机制,而是对其去年9月引入的安全体系的延续与拓展。去年9月,OpenAI曾推出针对青少年账户的家长控制功能,允许家长对青少年的ChatGPT账户进行一定程度的监督,其中就包括接收安全通知——当OpenAI系统判断其子女面临“严重安全风险”时,会及时向家长发送提醒,为青少年用户筑牢安全屏障。除此之外,一段时间以来,ChatGPT也已内置自动提示功能,当对话内容趋向自残等危险话题时,会主动引导用户寻求专业的健康服务,提前规避安全风险。

需要明确的是,“可信联系人”功能属于可选功能,并非强制开启。这也就意味着,即使用户在某个ChatGPT账户中激活了该保护机制,仍可以注册并使用多个ChatGPT账户,这一设定也使得该功能的防护效果存在一定局限。巧合的是,OpenAI此前推出的家长控制功能同样为可选功能,因此也存在类似的局限性,无法实现全方位、无死角的安全防护。

OpenAI在官方公告中表示:“‘可信联系人’是OpenAI更广泛努力的一部分,旨在构建能在困难时刻帮助人们的人工智能系统。我们将继续与临床医生、研究人员和政策制定者合作,改进人工智能系统在人们可能感到痛苦时的应对方式。”据悉,该功能在开发过程中,OpenAI还咨询了内部“人工智能与福祉专家委员会”以及美国心理学会,力求在介入用户私人危机与保护用户隐私之间找到平衡,让技术真正成为守护用户安全的助力而非负担。