- 联系我们

- duidaima.com 版权声明

- 闽ICP备2020021581号

-

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

这个实现类是我们早期使用最多的对象,它可以操作Excel2003以前(包含2003)的所有Excel版本。在2003以前Excel的版本后缀还是.xls

这个实现类现在在很多公司都可以发现还在使用,它是操作的Excel2003--Excel2007之间的版本,Excel的扩展名是.xlsx

这个实现类是POI3.8之后的版本才有的,它可以操作Excel2007以后的所有版本Excel,扩展名是.xlsx 。大致知道了我们在导入导出操作的时候会用到这样三个实现类以及他们可以操作的Excel版本和后缀之后,我们就要从优缺点分析他们了

它的优点是 不会报内存溢出。(因为数据量还不到7w所以内存一般都够用,首先你得明确知道这种方式是将数据先读取到内存中,然后再操作)

缺点:伴随的问题来了,虽然导出数据行数增加了好多倍,但是随之而来的内存溢出问题也成了噩梦。因为你所创建的book,Sheet,row,cell等在写入到Excel之前,都是存放在内存中的(这还没有算Excel的一些样式格式等等),可想而知,内存不溢出就有点不科学了!!!

//导出逻辑代码

public void dataExport300w(HttpServletResponse response) {

{

OutputStream outputStream = null;

try {

long startTime = System.currentTimeMillis();

System.out.println("导出开始时间:" + startTime);

outputStream = response.getOutputStream();

ExcelWriter writer = new ExcelWriter(outputStream, ExcelTypeEnum.XLSX);

String fileName = new String(("excel100w").getBytes(), "UTF-8");

// 堆代码 duidaima.com

//title

Table table = new Table(1);

List<List<String>> titles = new ArrayList<List<String>>();

titles.add(Arrays.asList("onlineseqid"));

titles.add(Arrays.asList("businessid"));

titles.add(Arrays.asList("becifno"));

titles.add(Arrays.asList("ivisresult"));

titles.add(Arrays.asList("createdby"));

titles.add(Arrays.asList("createddate"));

titles.add(Arrays.asList("updateby"));

titles.add(Arrays.asList("updateddate"));

titles.add(Arrays.asList("risklevel"));

table.setHead(titles);

//模拟统计查询的数据数量这里模拟100w

int count = 3000001;

//记录总数:实际中需要根据查询条件进行统计即可

Integer totalCount = actResultLogMapper.findActResultLogByCondations(count);

//每一个Sheet存放100w条数据

Integer sheetDataRows = ExcelConstants.PER_SHEET_ROW_COUNT;

//每次写入的数据量20w

Integer writeDataRows = ExcelConstants.PER_WRITE_ROW_COUNT;

//计算需要的Sheet数量

Integer sheetNum = totalCount % sheetDataRows == 0 ? (totalCount / sheetDataRows) : (totalCount / sheetDataRows + 1);

//计算一般情况下每一个Sheet需要写入的次数(一般情况不包含最后一个sheet,因为最后一个sheet不确定会写入多少条数据)

Integer oneSheetWriteCount = sheetDataRows / writeDataRows;

//计算最后一个sheet需要写入的次数

Integer lastSheetWriteCount = totalCount % sheetDataRows == 0 ? oneSheetWriteCount : (totalCount % sheetDataRows % writeDataRows == 0 ? (totalCount / sheetDataRows / writeDataRows) : (totalCount / sheetDataRows / writeDataRows + 1));

//开始分批查询分次写入

//注意这次的循环就需要进行嵌套循环了,外层循环是Sheet数目,内层循环是写入次数

List<List<String>> dataList = new ArrayList<>();

for (int i = 0; i < sheetNum; i++) {

//创建Sheet

Sheet sheet = new Sheet(i, 0);

sheet.setSheetName("测试Sheet1" + i);

//循环写入次数: j的自增条件是当不是最后一个Sheet的时候写入次数为正常的每个Sheet写入的次数,如果是最后一个就需要使用计算的次数lastSheetWriteCount

for (int j = 0; j < (i != sheetNum - 1 ? oneSheetWriteCount : lastSheetWriteCount); j++) {

//集合复用,便于GC清理

dataList.clear();

//分页查询一次20w

PageHelper.startPage(j + 1 + oneSheetWriteCount * i, writeDataRows);

List<ActResultLog> reslultList = actResultLogMapper.findByPage100w();

if (!CollectionUtils.isEmpty(reslultList)) {

reslultList.forEach(item -> {

dataList.add(Arrays.asList(item.getOnlineseqid(), item.getBusinessid(), item.getBecifno(), item.getIvisresult(), item.getCreatedby(), Calendar.getInstance().getTime().toString(), item.getUpdateby(), Calendar.getInstance().getTime().toString(), item.getRisklevel()));

});

}

//写数据

writer.write0(dataList, sheet, table);

}

}

// 下载EXCEL

response.setHeader("Content-Disposition", "attachment;filename=" + new String((fileName).getBytes("gb2312"), "ISO-8859-1") + ".xlsx");

response.setContentType("multipart/form-data");

response.setCharacterEncoding("utf-8");

writer.finish();

outputStream.flush();

//导出时间结束

long endTime = System.currentTimeMillis();

System.out.println("导出结束时间:" + endTime + "ms");

System.out.println("导出所用时间:" + (endTime - startTime) / 1000 + "秒");

} catch (FileNotFoundException e) {

e.printStackTrace();

} catch (IOException e) {

e.printStackTrace();

} finally {

if (outputStream != null) {

try {

outputStream.close();

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

}

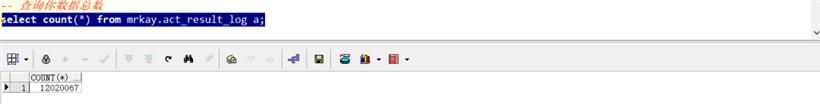

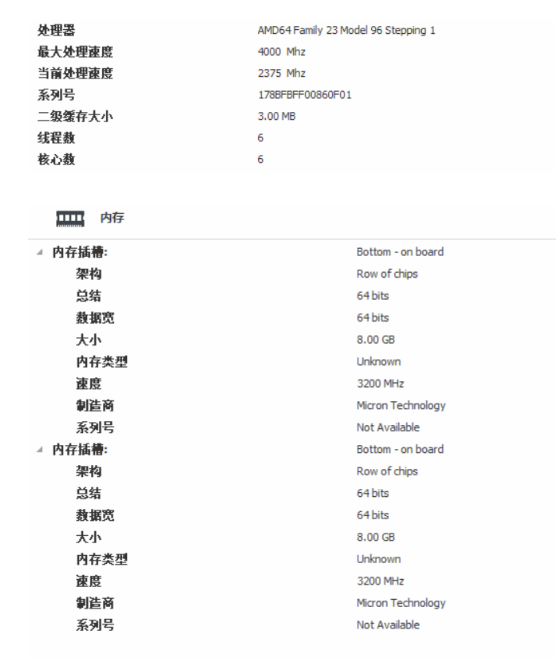

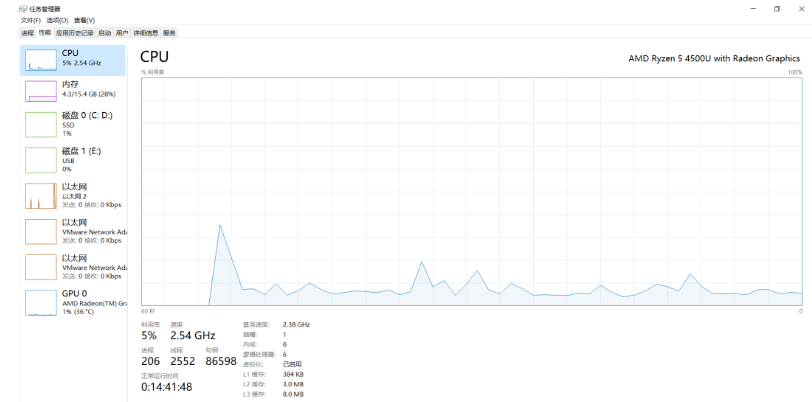

3.2.1 测试机状态

<select id="findByPage300w" resultType="show.mrkay.pojo.ActResultLog">

select *

from ACT_RESULT_LOG

where rownum <![CDATA[<]]> 3000001

</select>

-- 建表语句:可以参考一下

-- Create table

create table ACT_RESULT_LOG

(

onlineseqid VARCHAR2(32),

businessid VARCHAR2(32),

becifno VARCHAR2(32),

ivisresult VARCHAR2(32),

createdby VARCHAR2(32),

createddate DATE,

updateby VARCHAR2(32),

updateddate DATE,

risklevel VARCHAR2(32)

)

tablespace STUDY_KAY

pctfree 10

initrans 1

maxtrans 255

storage

(

initial 64K

next 1M

minextents 1

maxextents unlimited

);

3.2.3 测试结果

// 堆代码 duidaima.com

// EasyExcel的读取Excel数据的API

@Test

public void import2DBFromExcel10wTest() {

String fileName = "D:\\StudyWorkspace\\JavaWorkspace\\java_project_workspace\\idea_projects\\SpringBootProjects\\easyexcel\\exportFile\\excel300w.xlsx";

//记录开始读取Excel时间,也是导入程序开始时间

long startReadTime = System.currentTimeMillis();

System.out.println("------开始读取Excel的Sheet时间(包括导入数据过程):" + startReadTime + "ms------");

//读取所有Sheet的数据.每次读完一个Sheet就会调用这个方法

EasyExcel.read(fileName, new EasyExceGeneralDatalListener(actResultLogService2)).doReadAll();

long endReadTime = System.currentTimeMillis();

System.out.println("------结束读取Excel的Sheet时间(包括导入数据过程):" + endReadTime + "ms------");

}

// 事件监听

public class EasyExceGeneralDatalListener extends AnalysisEventListener<Map<Integer, String>> {

/**

* 处理业务逻辑的Service,也可以是Mapper

*/

private ActResultLogService2 actResultLogService2;

/**

* 用于存储读取的数据

*/

private List<Map<Integer, String>> dataList = new ArrayList<Map<Integer, String>>();

public EasyExceGeneralDatalListener() {

}

public EasyExceGeneralDatalListener(ActResultLogService2 actResultLogService2) {

this.actResultLogService2 = actResultLogService2;

}

@Override

public void invoke(Map<Integer, String> data, AnalysisContext context) {

//数据add进入集合

dataList.add(data);

//size是否为100000条:这里其实就是分批.当数据等于10w的时候执行一次插入

if (dataList.size() >= ExcelConstants.GENERAL_ONCE_SAVE_TO_DB_ROWS) {

//存入数据库:数据小于1w条使用Mybatis的批量插入即可;

saveData();

//清理集合便于GC回收

dataList.clear();

}

}

/**

* 保存数据到DB

*

* @param

* @MethodName: saveData

* @return: void

*/

private void saveData() {

actResultLogService2.import2DBFromExcel10w(dataList);

dataList.clear();

}

/**

* Excel中所有数据解析完毕会调用此方法

*

* @param: context

* @MethodName: doAfterAllAnalysed

* @return: void

*/

@Override

public void doAfterAllAnalysed(AnalysisContext context) {

saveData();

dataList.clear();

}

}

//JDBC工具类

public class JDBCDruidUtils {

private static DataSource dataSource;

/*

创建数据Properties集合对象加载加载配置文件

*/

static {

Properties pro = new Properties();

//加载数据库连接池对象

try {

//获取数据库连接池对象

pro.load(JDBCDruidUtils.class.getClassLoader().getResourceAsStream("druid.properties"));

dataSource = DruidDataSourceFactory.createDataSource(pro);

} catch (Exception e) {

e.printStackTrace();

}

}

/*

获取连接

*/

public static Connection getConnection() throws SQLException {

return dataSource.getConnection();

}

/**

* 关闭conn,和 statement独对象资源

*

* @param connection

* @param statement

* @MethodName: close

* @return: void

*/

public static void close(Connection connection, Statement statement) {

if (connection != null) {

try {

connection.close();

} catch (SQLException e) {

e.printStackTrace();

}

}

if (statement != null) {

try {

statement.close();

} catch (SQLException e) {

e.printStackTrace();

}

}

}

/**

* 关闭 conn , statement 和resultset三个对象资源

*

* @param connection

* @param statement

* @param resultSet

* @MethodName: close

* @return: void

*/

public static void close(Connection connection, Statement statement, ResultSet resultSet) {

close(connection, statement);

if (resultSet != null) {

try {

resultSet.close();

} catch (SQLException e) {

e.printStackTrace();

}

}

}

/*

获取连接池对象

*/

public static DataSource getDataSource() {

return dataSource;

}

}

# druid.properties配置

driverClassName=oracle.jdbc.driver.OracleDriver

url=jdbc:oracle:thin:@localhost:1521:ORCL

username=mrkay

password=******

initialSize=10

maxActive=50

maxWait=60000

// Service中具体业务逻辑

/**

* 测试用Excel导入超过10w条数据,经过测试发现,使用Mybatis的批量插入速度非常慢,所以这里可以使用 数据分批+JDBC分批插入+事务来继续插入速度会非常快

*

* @param

* @MethodName: import2DBFromExcel10w

* @return: java.util.Map<java.lang.String, java.lang.Object>

*/

@Override

public Map<String, Object> import2DBFromExcel10w(List<Map<Integer, String>> dataList) {

HashMap<String, Object> result = new HashMap<>();

//结果集中数据为0时,结束方法.进行下一次调用

if (dataList.size() == 0) {

result.put("empty", "0000");

return result;

}

//JDBC分批插入+事务操作完成对10w数据的插入

Connection conn = null;

PreparedStatement ps = null;

try {

long startTime = System.currentTimeMillis();

System.out.println(dataList.size() + "条,开始导入到数据库时间:" + startTime + "ms");

conn = JDBCDruidUtils.getConnection();

//控制事务:默认不提交

conn.setAutoCommit(false);

String sql = "insert into ACT_RESULT_LOG (onlineseqid,businessid,becifno,ivisresult,createdby,createddate,updateby,updateddate,risklevel) values";

sql += "(?,?,?,?,?,?,?,?,?)";

ps = conn.prepareStatement(sql);

//循环结果集:这里循环不支持"烂布袋"表达式

for (int i = 0; i < dataList.size(); i++) {

Map<Integer, String> item = dataList.get(i);

ps.setString(1, item.get(0));

ps.setString(2, item.get(1));

ps.setString(3, item.get(2));

ps.setString(4, item.get(3));

ps.setString(5, item.get(4));

ps.setTimestamp(6, new Timestamp(System.currentTimeMillis()));

ps.setString(7, item.get(6));

ps.setTimestamp(8, new Timestamp(System.currentTimeMillis()));

ps.setString(9, item.get(8));

//将一组参数添加到此 PreparedStatement 对象的批处理命令中。

ps.addBatch();

}

//执行批处理

ps.executeBatch();

//手动提交事务

conn.commit();

long endTime = System.currentTimeMillis();

System.out.println(dataList.size() + "条,结束导入到数据库时间:" + endTime + "ms");

System.out.println(dataList.size() + "条,导入用时:" + (endTime - startTime) + "ms");

result.put("success", "1111");

} catch (Exception e) {

result.put("exception", "0000");

e.printStackTrace();

} finally {

//关连接

JDBCDruidUtils.close(conn, ps);

}

return result;

}

3.3.3 测试结果------开始读取Excel的Sheet时间(包括导入数据过程):1623127873630ms------ 200000条,开始导入到数据库时间:1623127880632ms 200000条,结束导入到数据库时间:1623127881513ms 200000条,导入用时:881ms 200000条,开始导入到数据库时间:1623127886945ms 200000条,结束导入到数据库时间:1623127887429ms 200000条,导入用时:484ms 200000条,开始导入到数据库时间:1623127892894ms 200000条,结束导入到数据库时间:1623127893397ms 200000条,导入用时:503ms 200000条,开始导入到数据库时间:1623127898607ms 200000条,结束导入到数据库时间:1623127899066ms 200000条,导入用时:459ms 200000条,开始导入到数据库时间:1623127904379ms 200000条,结束导入到数据库时间:1623127904855ms 200000条,导入用时:476ms 200000条,开始导入到数据库时间:1623127910495ms 200000条,结束导入到数据库时间:1623127910939ms 200000条,导入用时:444ms 200000条,开始导入到数据库时间:1623127916271ms 200000条,结束导入到数据库时间:1623127916744ms 200000条,导入用时:473ms 200000条,开始导入到数据库时间:1623127922465ms 200000条,结束导入到数据库时间:1623127922947ms 200000条,导入用时:482ms 200000条,开始导入到数据库时间:1623127928260ms 200000条,结束导入到数据库时间:1623127928727ms 200000条,导入用时:467ms 200000条,开始导入到数据库时间:1623127934374ms 200000条,结束导入到数据库时间:1623127934891ms 200000条,导入用时:517ms 200000条,开始导入到数据库时间:1623127940189ms 200000条,结束导入到数据库时间:1623127940677ms 200000条,导入用时:488ms 200000条,开始导入到数据库时间:1623127946402ms 200000条,结束导入到数据库时间:1623127946925ms 200000条,导入用时:523ms 200000条,开始导入到数据库时间:1623127952158ms 200000条,结束导入到数据库时间:1623127952639ms 200000条,导入用时:481ms 200000条,开始导入到数据库时间:1623127957880ms 200000条,结束导入到数据库时间:1623127958925ms 200000条,导入用时:1045ms 200000条,开始导入到数据库时间:1623127964239ms 200000条,结束导入到数据库时间:1623127964725ms 200000条,导入用时:486ms ------结束读取Excel的Sheet时间(包括导入数据过程):1623127964725ms------看一下数据库的数据是不是真的存进去了300w。可以看到数据比导入前多了300W,测试很成功!