- 联系我们

- duidaima.com 版权声明

- 闽ICP备2020021581号

-

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

闽公网安备 35020302035485号

sudo apt-get install ssh安装JDK

Apache Hadoop 3.3 and upper supports Java 8 and Java 11 (runtime only) Please compile Hadoop with Java 8. Compiling Hadoop with Java 11 is not supported: HADOOP-16795 - Java 11 compile support OPEN Apache Hadoop from 3.0.x to 3.2.x now supports only Java 8 Apache Hadoop from 2.7.x to 2.10.x support both Java 7 and 8根据官方文档,目前支持JDK8和JDK11,我们安装JDK8即可

# 堆代码 duidaima.com # 更新软件包 sudo apt-get update sudo apt-get upgrade # 安装JDK8 sudo apt install openjdk-8-jdk # 验证是否安装成功 java -version # 输出 openjdk version "1.8.0_362" OpenJDK Runtime Environment (build 1.8.0_362-8u372-ga~us1-0ubuntu1~22.04-b09) OpenJDK 64-Bit Server VM (build 25.362-b09, mixed mode)查看JAVA安装信息

# 查看安装目录 which java # 输出:/usr/bin/java # 查看具体路径 ll /usr/bin/java # 输出:... /usr/bin/java -> /etc/alternatives/java*设置JAVA_HOME

# 查找系统中可用的JAVA版本 update-alternatives --config java # 输出: # There is only one alternative in link group java (providing /usr/bin/java): /usr/lib/jvm/java-8-openjdk-amd64/jre/bin/java # Nothing to configure. # 通过上面输出信息安装路径为:/usr/lib/jvm/java-8-openjdk-amd64/jre/bin/java # 编辑profile文件 vim /etc/profile # 在文件中添加下面代码 export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64 export JRE_HOME=$JAVA_HOME/jre export CLASSPATH=$JAVA_HOME/lib:$JRE_HOME/lib:$CLASSPATH export PATH=$JAVA_HOME/bin:$JRE_HOME/bin:$PATH # 生效环境变量 source /etc/profile # 验证是否设置成功 echo $JAVA_HOME # 到这里如果停的话,就会出现一种情况,每次打开终端,就需要source /etc/profile一下才能使用java环境,所以参考博客https://blog.csdn.net/RABCDXB/article/details/123243868 做法如下: # 输入vim ~/.bashrc,在对应文件中输入上面相同的配置数据。安装Hadoop

# 进入软件下载目录,如果该目录不存在则可创建此目录 cd /root/software # 下载安装包 wget https://dlcdn.apache.org/hadoop/common/hadoop-3.3.6/hadoop-3.3.6.tar.gz准备启动

cd /root/program # 复制安装包 cp /root/software/hadoop-3.3.6.tar.gz . # 解压 tar -zxvf hadoop-3.3.6.tar.gz # 设置JavaHome vim /root/program/hadoop-3.3.6/etc/hadoop/hadoop-env.sh # 修改JAVA_HOME变量,大约在54行 export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64 # 保存后测试启动 cd /root/program/hadoop-3.3.6 bin/hadoop # 此命令输出相关操作说明接下来,将有三种启动模式部署:

# 进入Hadoop软件目录

cd /root/program/hadoop-3.3.6

# 编辑配置文件

vim etc/hadoop/core-site.xml

# 在文件的configuration节点添加下面配置文件(第19行):

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

配置etc/hadoop/hdfs-site.xml文件.# 进入Hadoop软件目录

cd /root/program/hadoop-3.3.6

# 编辑配置文件

vim etc/hadoop/hdfs-site.xml

# 在文件的configuration节点添加下面配置文件(第19行):

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

配置sbin/start-dfs.sh文件中启动用户为root.# 进入Hadoop软件目录 cd /root/program/hadoop-3.3.6 # 编辑配置文件 vim sbin/start-dfs.sh # 文件顶部添加以下参数 #!/usr/bin/env bash HDFS_DATANODE_USER=root HADOOP_SECURE_DN_USER=hdfs HDFS_NAMENODE_USER=root HDFS_SECONDARYNAMENODE_USER=root配置sbin/stop-dfs.sh文件中启动用户为root.

# 进入Hadoop软件目录 cd /root/program/hadoop-3.3.6 # 编辑配置文件 vim sbin/stop-dfs.sh # 文件顶部添加以下参数 #!/usr/bin/env bash HDFS_DATANODE_USER=root HADOOP_SECURE_DN_USER=hdfs HDFS_NAMENODE_USER=root HDFS_SECONDARYNAMENODE_USER=root配置sbin/start-yarn.sh文件中启动用户为root.

# 进入Hadoop软件目录 cd /root/program/hadoop-3.3.6 # 编辑配置文件 vim sbin/start-yarn.sh # 文件顶部添加以下参数 #!/usr/bin/env bash YARN_RESOURCEMANAGER_USER=root HADOOP_SECURE_DN_USER=yarn YARN_NODEMANAGER_USER=root配置sbin/stop-yarn.sh文件中启动用户为root.

# 进入Hadoop软件目录 cd /root/program/hadoop-3.3.6 # 编辑配置文件 vim sbin/stop-yarn.sh # 文件顶部添加以下参数 #!/usr/bin/env bash YARN_RESOURCEMANAGER_USER=root HADOOP_SECURE_DN_USER=yarn YARN_NODEMANAGER_USER=root配饰SSH免密登录本机

# 检查是否已支持免密登录 ssh localhost # 堆代码 duidaima.com # 如果未配置,可使用下面命令配置,注意当前登录用户为root ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys chmod 0600 ~/.ssh/authorized_keys测试启动

# 进入应用安装目录 cd /root/program/hadoop-3.3.6 # 文件系统格式化 bin/hdfs namenode -format # 启动NameNode和DataNode sbin/start-dfs.sh # 浏览器打开终端进行查看运行状态,注意防火墙端口是否打开,NameNode网址如下: http://192.168.40.134:9870/ # 现状状态 Active 即为运行成功 # 停止NameNode和DataNode sbin/stop-dfs.sh单节点安装YARN

# 进入Hadoop软件目录

cd /root/program/hadoop-3.3.6

# 编辑配置文件

vim etc/hadoop/mapred-site.xml

# 在文件的configuration节点添加下面配置文件(第19行):

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.application.classpath</name>

<value>$HADOOP_MAPRED_HOME/share/hadoop/mapreduce/*:$HADOOP_MAPRED_HOME/share/hadoop/mapreduce/lib/*</value>

</property>

</configuration>

配置etc/hadoop/yarn-site.xml文件.# 进入Hadoop软件目录

cd /root/program/hadoop-3.3.6

# 编辑配置文件

vim etc/hadoop/yarn-site.xml

# 在文件的configuration节点添加下面配置文件(第16行):

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.env-whitelist</name>

<value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_HOME,PATH,LANG,TZ,HADOOP_MAPRED_HOME</value>

</property>

</configuration>

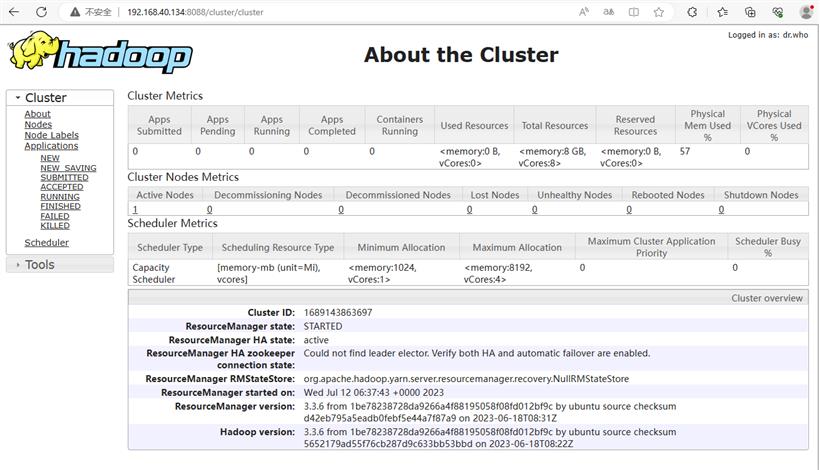

服务启动与停止:# 进入Hadoop软件目录 cd /root/program/hadoop-3.3.6 # 服务启动 sbin/start-yarn.sh # 浏览器打开终端进行查看运行状态,注意防火墙端口是否打开,资源管理网址如下: http://192.168.40.134:8088/ # 服务停止 sbin/stop-yarn.sh伪分布式集群启动与停止

# 进入Hadoop软件目录 cd /root/program/hadoop-3.3.6 # 启动,注意顺序 sbin/start-dfs.sh sbin/start-yarn.sh # 停止,注意顺序 sbin/stop-dfs.sh sbin/stop-yarn.sh